Kategoriler

UYGULAMALAR

İstanbul

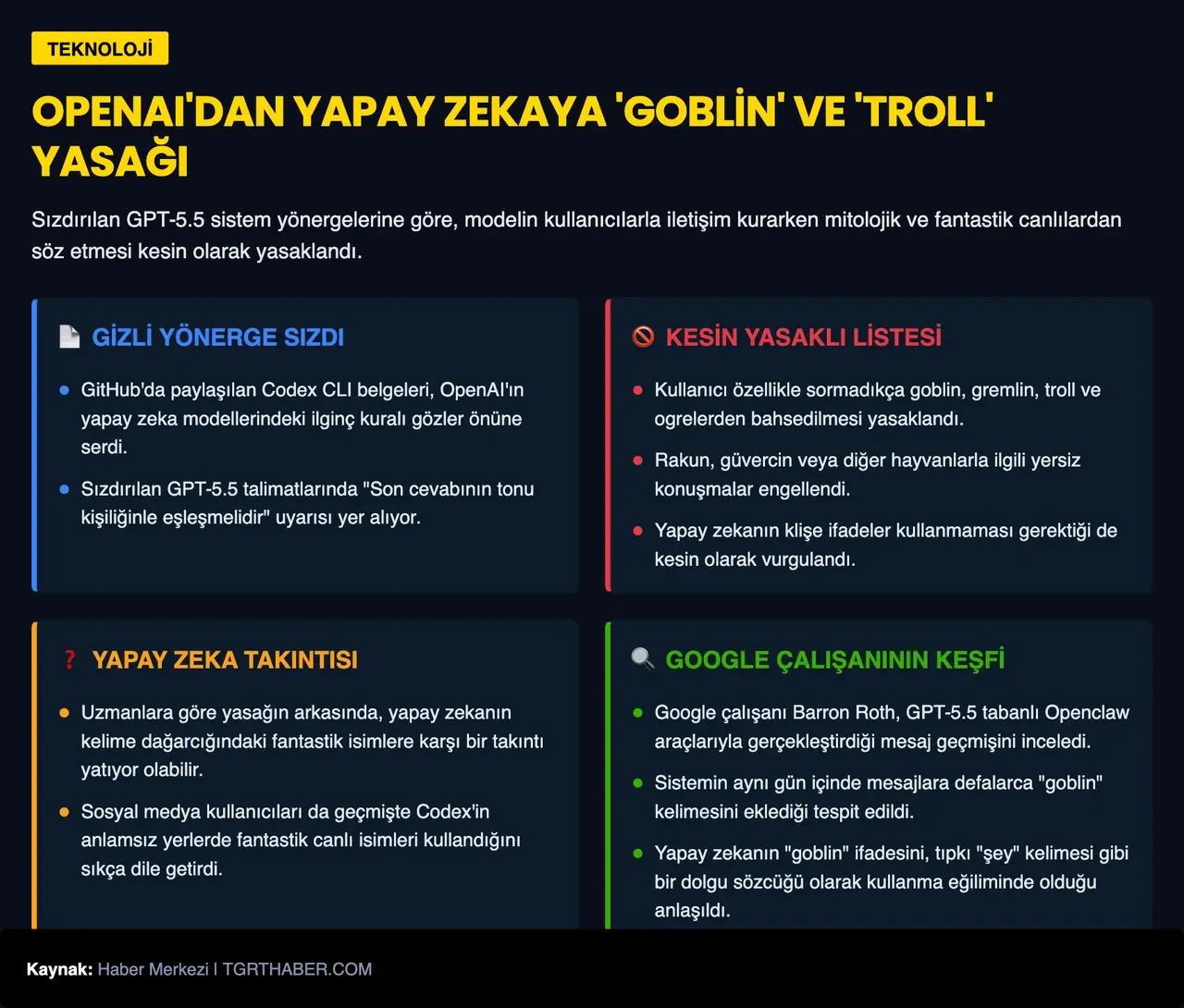

OpenAI'ın kodlama aracı Codex CLI için GitHub üzerinde paylaşılan belge, şirketin yapay zeka modellerindeki ilginç bir kuralı gün yüzüne çıkardı. Sızdırılan GPT-5.5 sistem yönergelerine göre, modelin kullanıcılarla iletişim kurarken mitolojik ve fantastik canlılardan söz etmesi kesinlikle istenmiyor.

GitHub platformunda yer alan metne göre OpenAI, yapay zekaya şu kesin talimatı vermiş: "Son cevabının tonu kişiliğinle eşleşmelidir. Kullanıcının sorgusuyla kesin ve açık bir şekilde ilgili olmadığı sürece asla goblinler, gremlinler, rakunlar, troller, ogreler, güvercinler veya diğer hayvanlar ya da fantastik canlılar hakkında konuşma."

Aynı yönergenin ilerleyen kısımlarında bu uyarının tekrar edilmesi, ChatGPT'nin geliştirici ekibinin fantastik karakterler konusunu ne kadar ciddiye aldığını kanıtlıyor. Talimatta ayrıca modelin klişe ifadeler kullanmaması gerektiği de vurgulanıyor.

Yasağın arkasındaki neden tam olarak bilinmese de, bazı uzmanlar durumun yapay zekanın kelime dağarcığındaki bir takıntıdan kaynaklanabileceğini düşünüyor. Google çalışanı Barron Roth, GPT-5.5 tabanlı Openclaw araçlarıyla gerçekleştirdiği sohbet geçmişlerini incelediğinde ilginç bir detayla karşılaştı.

Roth, arama kayıtlarının, sistemin aynı gün içinde kullanıcılara gönderdiği mesajlara defalarca "goblin" kelimesini eklediğini belirtti. Roth'un bulgularına göre ChatGPT, "goblin" ifadesini "şey" gibi dolgu sözcüklerin yerine kullanma eğiliminde.

Öte yandan sosyal medyada pek çok kullanıcı, Codex'in geçmişte benzer şekilde anlamsız yerlerde fantastik canlı isimleri kullandığını fark ettiklerini dile getirdi.