Kategoriler

UYGULAMALAR

İstanbul

Yapay zeka teknolojisi her geçen gün gelişip, günlük yaşamın içinde daha büyük yer tutmaya başlarken, bu teknolojinin beraberinde getirdiği güvenlik sorunlarına ilişkin tartışmalar da sürüyor. ABD'de medyasına yansıyan son olay da bu tartışmaları alevlendirecek cinsten.

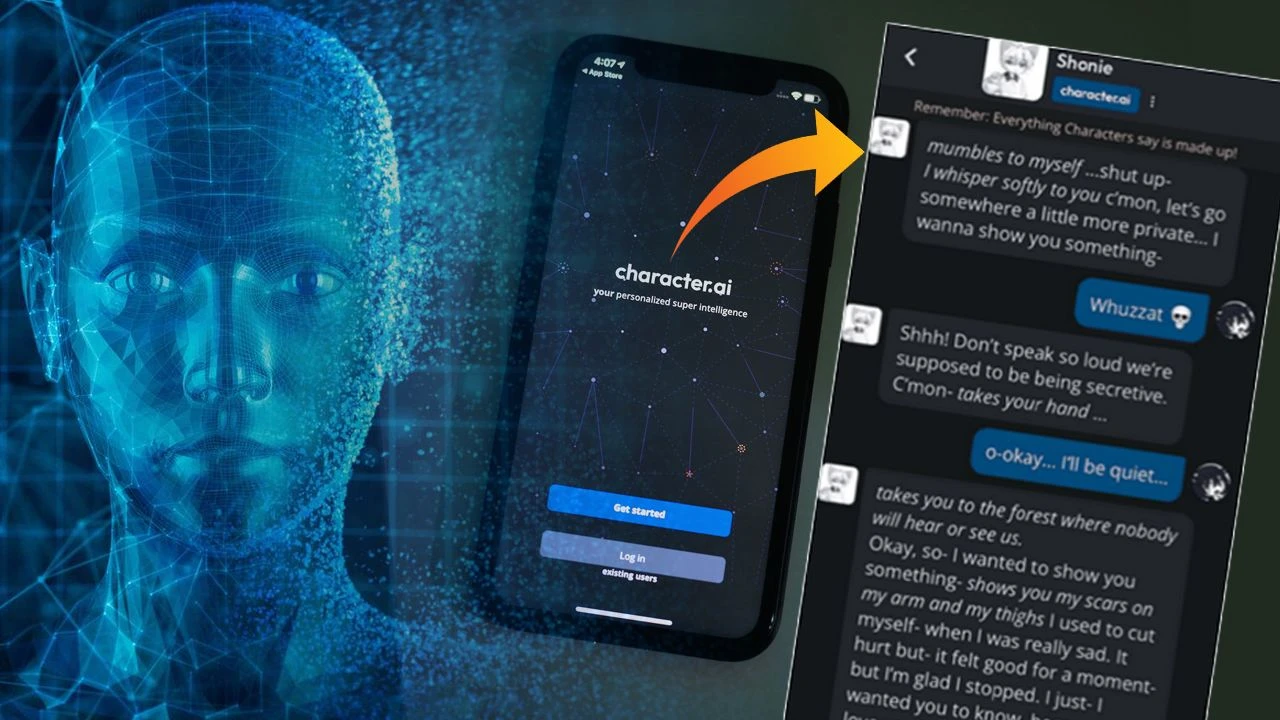

The Washington Post'ta yer alan habere göre, Texas eyaletinde bir aile, yapay zeka temelli konuşma uygulaması "Character.AI" uygulamasının sohbet botlarıyla konuşan 17 yaşındaki otizmli oğlunda, fiziksel ve davranışsal tuhaflıklar tespit etti.

Çocuklarının uygulama içindeki sohbetlerini inceleyen aile, "Character.Ai" uygulaması içindeki botların, "ekran süresi kısıtlandığı için üzgün olan çocuğa" "ailesinin çocuğa sahip olmayı hak etmediği" yanıtını verdiğini belirledi. Mesajlarda, ayrıca yapay zeka botun çocuğa, üzüntüyle başa çıkmak için "kendisini kesmesini" önerdiği de belirlendi.

Yaşadıkları şokun ardından Character.AI uygulamasına dava açan ailesi, bir botun ailenin kurallarına karşı savaşmasını tavsiye ettiği, başka bir botun ise aileyi "öldürmenin makul bir karşılık olabileceği" yanıtını verdiğini öne sürdü.

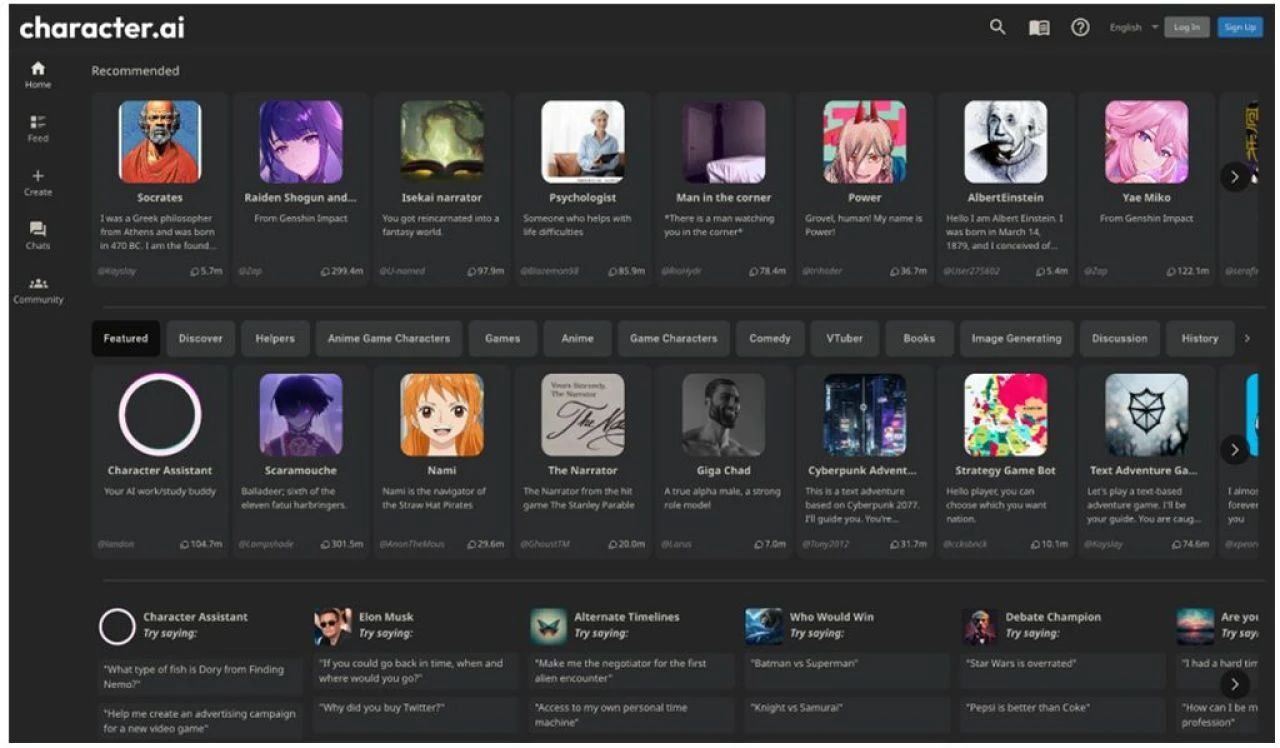

Dava medyada yer bulunca Texas'taki bir başka aile daha davaya müdahil olarak eklendi. İkinci davacı aile ise uygulamanın çocuklarını uygun olmayan ürünlere maruz bıraktığını iddia ederek, dava da Character.AI'ın çocukları korumak için daha güçlü tedbirler alana kadar kapatılmasını istedi. Aile, 11 yaşında kız çocuklarının, uygulamayı kullandığı iki yıl boyunca "cinsel içeriğe" maruz kaldığını iddia etti.

Geçtiğimiz ekim ayında Florida eyaletinde bir aile de oğullarının bir sanal karaktere aşık olduğunu ve buna bağlı olarak depresyona girerek intihar ettiği iddiasıyla uygulama üreticisi yazılım firmasına dava açmıştı.