Kategoriler

UYGULAMALAR

İstanbul

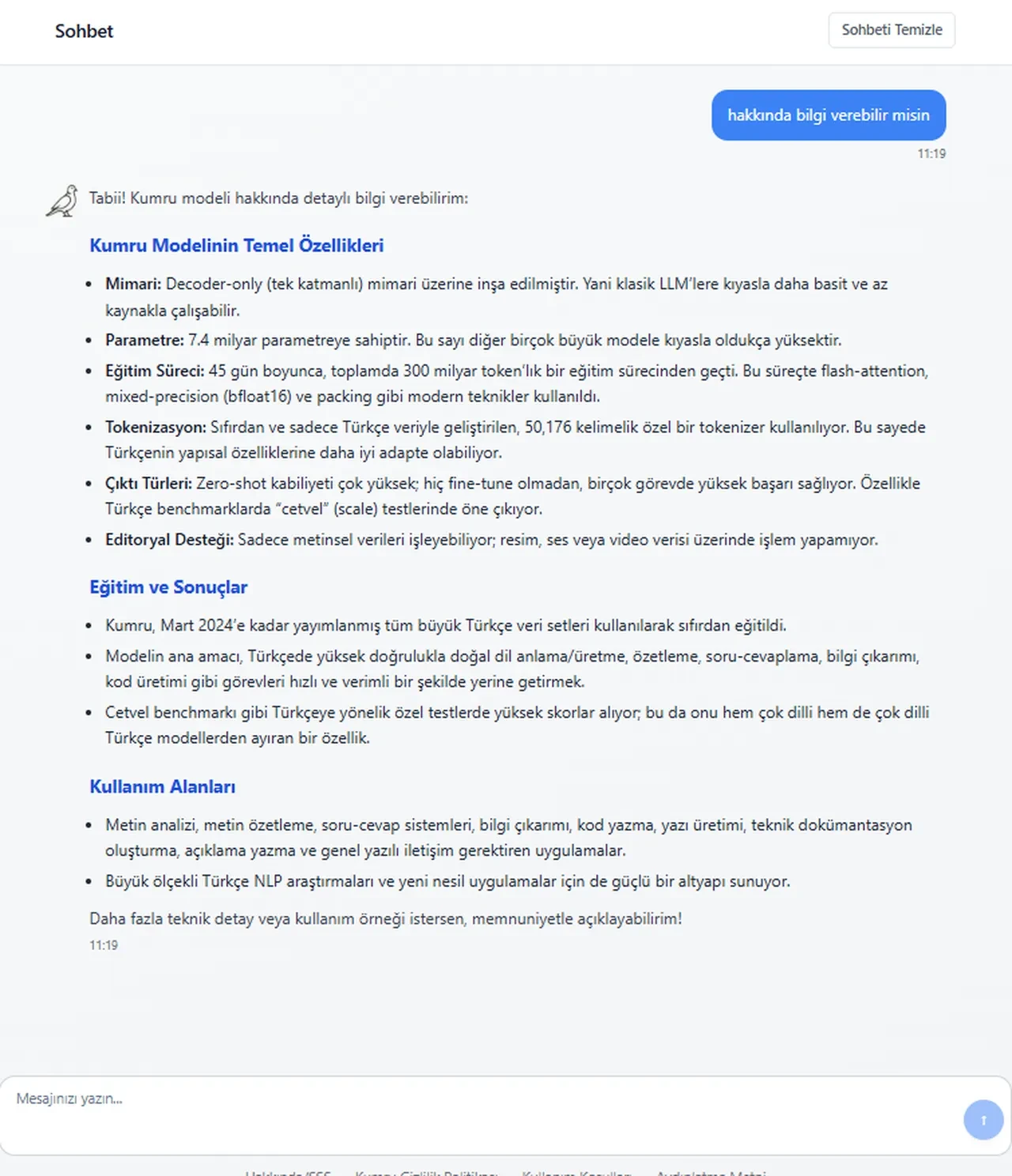

Yapay zeka, bulut ve yazılım üzerine çalışan VNGRS tarafından geliştirilen Kumru Türkçe için sıfırdan geliştirilmiş ve eğitilmiş ilk temel dil modeli oldu. 7.4 milyar parametreye sahip, zengin kaynaklardan beslenen Kumru'da 500 GB'lık temizlenmiş, tekilleştirilmiş bir veriseti ile 300 milyar token eğitilen model 8,192 token'lık bir context length kullanılmakta.

Türkçe LLM benchmark'ında LLaMA-3.3-70B, QWen-2-72B, Gemma-3-27B, Aya-32B gibi kendisinden çok daha büyük açık kaynak modellerden daha yüksek skorlar almıştır. Model, verimliliği sayesinde 16 GB VRAM'e sahip GPU'larda quantization gibi tekniklere gerek duyulmaksızın kurum içi yerinde kullanılabiliyor.

Yaratıcı yazım işlerinde daha başarılı olan Kumru'ya sağlanan metin ve dokümanları anlayıp özetlemek, soru cevaplamak, başka şekilde yeniden yazmak, başlık atmak, etiketlemek, tasnif etmek gibi işleri başarıyla yapabiliyor ve 26 farklı kategoride test edilen kendisinden daha büyük LLaMA ve Gemma gibi açık modelleri geride bıraktı.

Kumru 45 günlük ön eğitim aşamasında NVIDIA’nın H100 ve H200 GPU’ları üzerinde 500 GB büyüklüğünde veri ile eğitilerek Mistral-v0.3 üzerine inşa edildi. Ayrıca Kumru'nun geliştirilmesinde Meta'nın LLaMA-3 modelinden de destek alındı.